本文转载自:酷玩实验室(ID:coollabs)

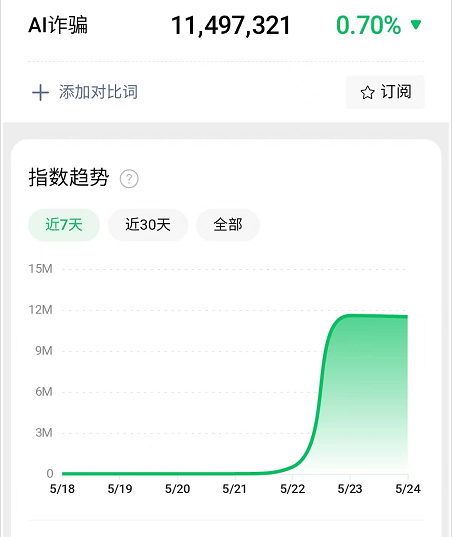

不知大家最近有没有察觉,关于AI诈骗的消息简直可以说是铺天盖地。光是这一周,就已经喜提了三个微博热搜。

而微信指数,也从22号之前的无人问津,一下暴涨到1150万的搜索热度。

这热度的起因,其实源于包头警方公布的一宗诈骗案。

01

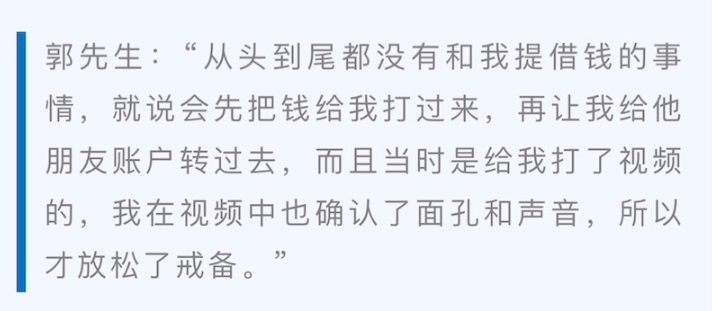

案件发生在福州,主角是某科技公司的法人代表郭先生。某天郭先生的好友通过微信找到郭先生,说他的一位朋友在外地竞标,需要430万的保证金,但得公对公账户过账,便想借用郭先生的公司过个账。

这事虽少,但也偶尔有之,不算什么大事。郭先生通过微信视频确认了跟他通话的人,就是他的朋友后,便爽快地答应了。

很快,那位朋友就给郭先生发了一张转账成功的截图。出于对朋友的信任,郭先生在没有核实款项是否到账的情况下,直接就把自己卡里的430万转到了那朋友给的卡号上。

整个过程,耗时十分钟。

转完之后,郭先生觉得有必要再确认一下,便给朋友打了个电话,这才惊觉:

十分钟前那个跟他通话的朋友,居然是骗子用AI技术伪造的!

而整个案件的诈骗手法,大致如下:

首先,诈骗团伙可能通过木马远程操控了郭先生好友的微信,从而获取到这位朋友的照片及语音等资料。这些资料被用来喂给AI,以便生成后面要用来诈骗的视频和语音。

然后,骗子们便开始浏览郭先生这位朋友的微信聊天记录,以筛选出有钱且跟这位朋友关系好的诈骗目标。

在选定了郭先生之后,诈骗团伙还得将微信视频实时传输的视频及音频数据,替换成事先用AI生成的视频和音频。以此获取郭先生的信任,实施诈骗。

纵观全程,像不像是好莱坞电影里才有那些高科技犯罪情节?

但非常遗憾的告诉大家,上述运用到的技术手段,其实一年前就有了。换句话说,chatgpt3.5出来之前,就已经存在了。

早在去年的1月2日,B站UP主@林亦LYi 就发布过一期用AI复制自己好友的视频。

在视频里面,UP主说道,只需一段5秒的语音,AI就能把一个人的声音完全复刻,之后不管要想那个人说什么话,都能用AI替他讲出来。

至于视频的生成,那更是简单。仅需一张照片,就能变脸生成视频,还能把说话的口型对好。其流畅的程度,若不是事先知道右边的原画,你压根看不出其中的违和之处。

相较之下,反倒是微信视频通话的摄像头数据替换,看起来略显简单,一个APP就能搞定,根本没啥技术含量。

话虽如此,但不知道大家有没有从上面三个技术琢磨出一些结论?如果没有,我这里倒是有一个现成的——

只要给AI一张照片和5秒语音,它就能复刻出一个你认识的人,来跟你视频…

不过这还不是最恐怖的,因为以上这些技术,一年前就有了。那么现在的技术又如何呢?

最近一个提醒大家提防网恋的视频里,向我们展示了一秒换脸术。

但最逆天的是,现在的AI不仅能换脸,都到了连肤色都可以改变的程度。

如果未来有了更高性能电脑和算法的加持,AI实时拍摄渲染,并进行特定场景的生成,那么微博热搜里的那句#AI诈骗成功率接近100%#,可能真就不是什么危言耸听了。

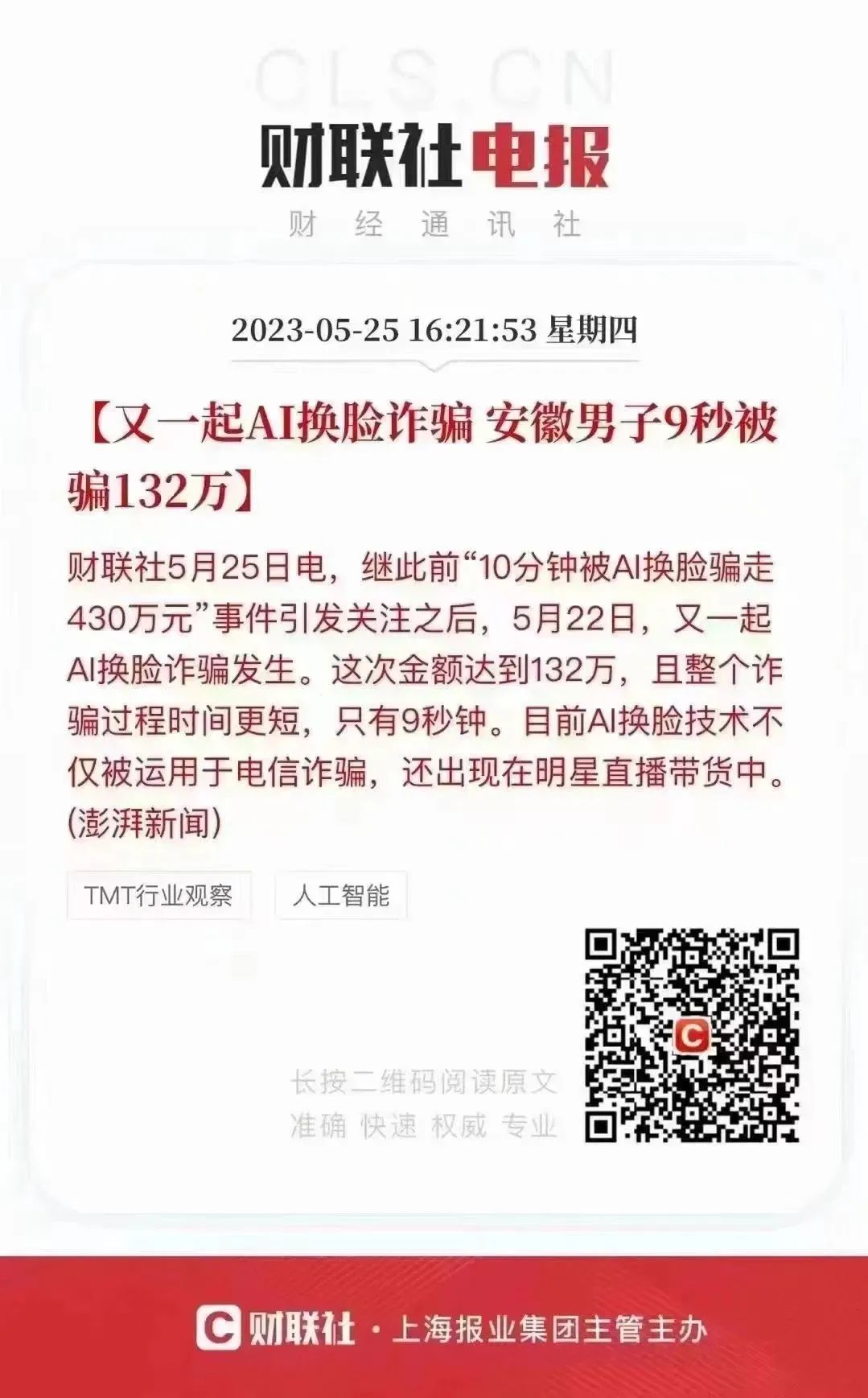

事实上,我才写完上面这部分,另一起AI诈骗的消息又冒了出来。这次更快,用时仅9秒,安徽某男子就被骗走了132万。

难怪当AI技术被用于诈骗这事一出来后,官媒们便纷纷下场呼吁,警惕AI诈骗!

但与官媒的紧张相反,大部分人好像对AI诈骗的破坏性,仍然停留在一个非常初级的阶段:觉得只要管住自己的钱袋子,AI诈骗就拿他们没辙。

可事实上,这一波AI诈骗,比之前所有的诈骗手法,都要来得更狠更精准!但同时,操作起来却也更加简单了…

大家可能有所不知,市面上所有的诈骗行为,其实都可以归结于四个步骤:

一句话解释,就是骗子跟你进行接触后,通过一系列伪装获取你的信任,并用事先准备好的脚本说辞,让你陷入一个被动的服从境地,最终让你听从骗子的指示,做出某种行为伤及自身利益的事情。

这其中,又以获取信任这步最为重要。操作得当,简直可以达到洗脑的效果。

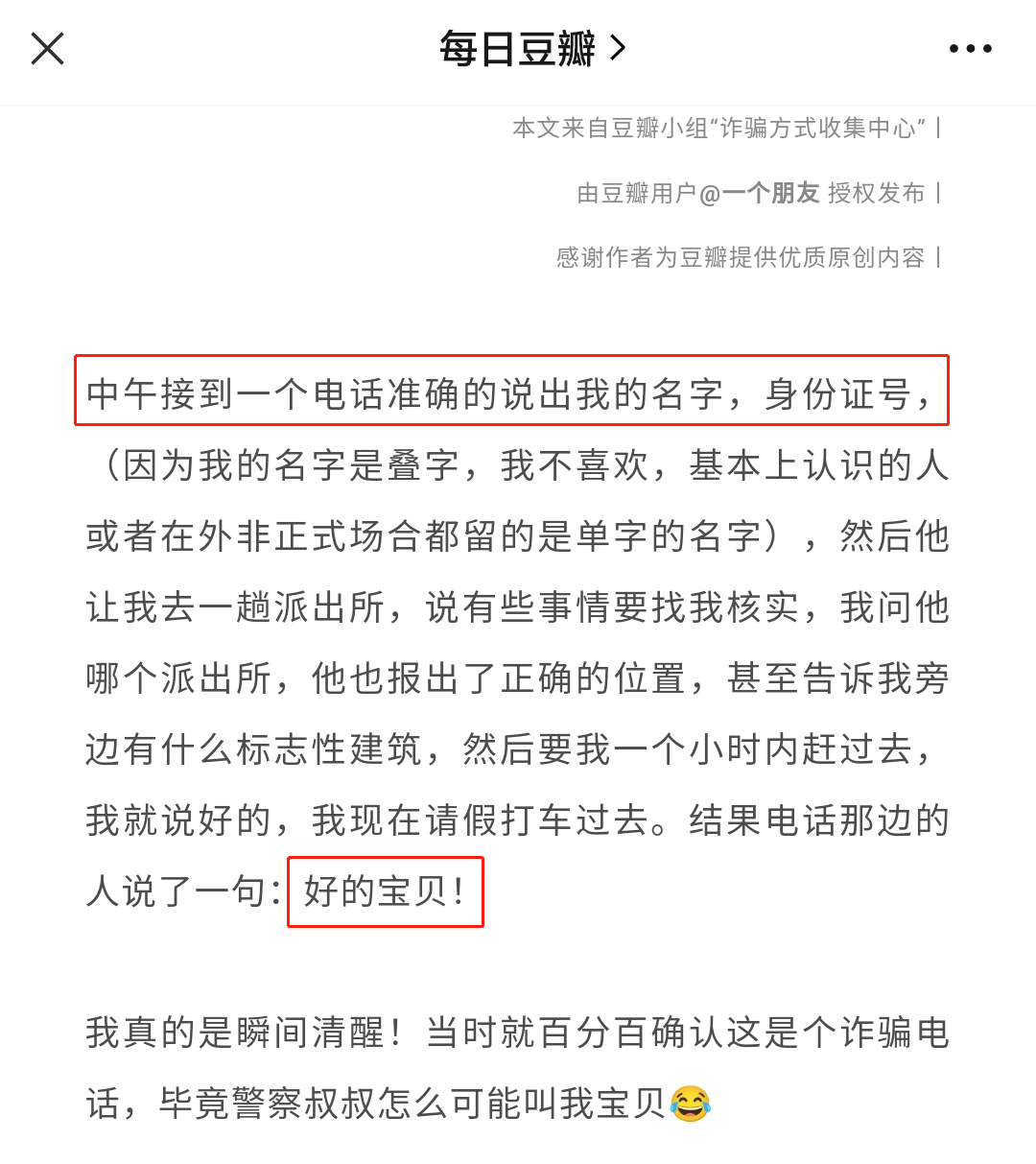

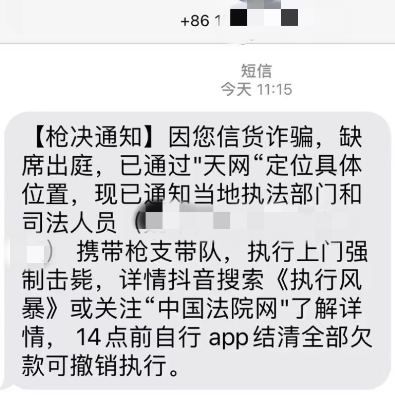

在AI诈骗出现以前,获取陌生人的信任最常见的方式,就是假扮权威人士。骗子们通过一些非法渠道获取你的个人身份信息后,冒充公安、检察院、法院,甚至反诈中心等工作人员给你打电话。

然后编造你涉嫌银行卡洗钱等罪名,并同步发送伪造的公检法官网通缉令、财产冻结书等,对你进行威逼、恐吓,以使你相信和就范。

然而随着反诈的普及和深入,越来越多人了解到了相关的手法后,这一方式开始变得不那么管用了。

可是当AI进入诈骗这个领域后,整个玩法都变了。这时获取信任,已不再需要那种广撒网、全凭运气钓到冤大头的方式了。

就拿最近热传的枪决诈骗短信来说,大家都觉得这条消息假得离谱,但它本意就是以此来筛选那些信以为真的傻子,这样骗子的诈骗成功率才高。

但也只是高而已,完全没有可能接近100%,甚至可能连0.00001%都不到,效率极其低下。

但AI诈骗则是完全利用你对熟人的信任。这时的杀伤力,可就不是一个数量级的了。

前面两个案例,已经充分说明了这一点。一个10分钟,另一个才9秒,以至于我们可以如此断言:用AI诈骗时,耗时短,见效快,几乎不会引起受害者的怀疑。

此外,AI诈骗还有另一个显著的特点,那就是涉及金额巨大。先不说安徽男子9秒被骗132万,这种巨离谱情况。

作为一家科技公司的法人代表郭先生,按说也是见过世面的人。却也在短短10分钟内,被骗子卷走了430万…最后多亏了警方和银行的通力合作,才帮郭先生挽回了大笔损失。

可见AI诈骗,完全有能力把受害者的所有积蓄都给掏空!

就拿前面提到的“扮演权威人士”举例。骗子扮演公安,最多也只能从你这里骗走几万块钱,因为金额一多,你自己都会感觉离谱,甚至产生怀疑。

比如你是财务,而骗子通过AI假冒成你老板,让你给他转一笔钱,好用来收购一家公司呢?

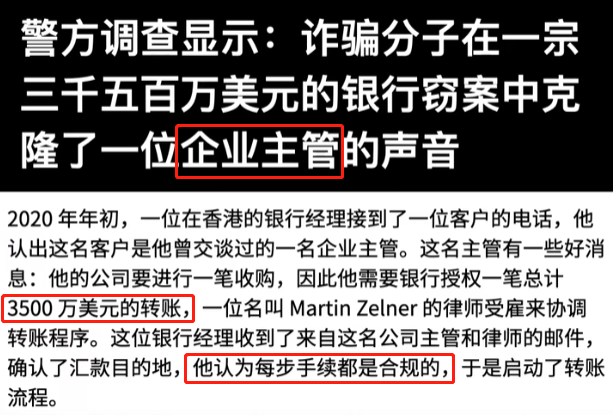

这其实是个真实事件,2020年初,一位银行经理就是这样被AI合成的声音,骗走了3500万美元。

在AI诈骗精能准取得信任,并有超强破坏力的情况下了。一个迫切的问题摆在了我们面前——

如果某个生物走起路来像鸭子、说话像鸭子、长得像鸭子、啄食也像鸭子,那它肯定就是一只鸭子。

这句话,其实是“事物的外在特征,就是事物本质的表现”这一逻辑理论的通俗解释。

可如今有AI诈骗介入的网络世界,这一理论将不再适用。因为往后跟你用视频聊天的那个人,虽然TA说着你熟悉的口音,长着你习以为常的相貌,但却有可能完全不是你所认识的那个人。

还记得之前我有提到过,“大部分人都低估AI诈骗对自己的影响”吗?

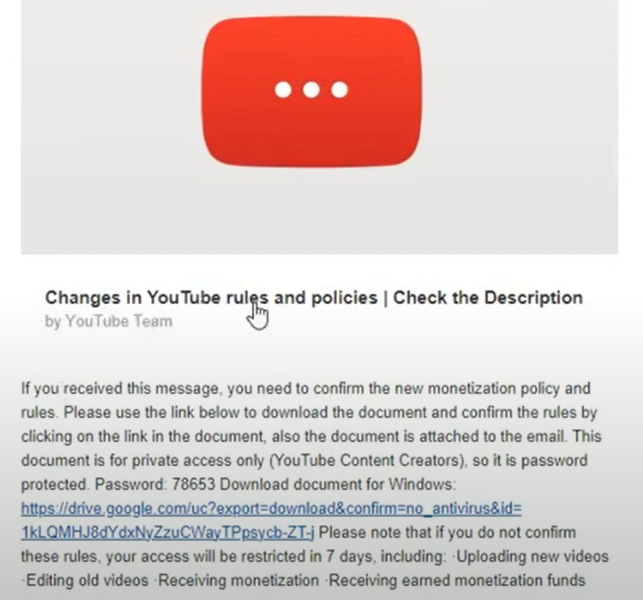

骗子们假借“YouTube团队”之名,向不少油管博主群发了一封电子邮件。说是油管最近出台一项新政策,建议各位油管博主下载相关细则进行查看。

这种钓鱼式的诈骗邮件,我们应该并不陌生。通常情况下,我们压根看都不看,直接点击删除。

但这封邮件里,却居然带了上一个谷歌CEO皮查伊“亲口解释”的视频,于是不少油管博主便放松了警惕,下载了相关政策的说明。

这个细则文件表面上看,是一个PDF文档没错,打开之后,也的确有着相关规则细节的解说。但它实际却是一个木马病毒,可以直接窃取你浏览器保存的所有密码等相关资料(郭先生那位好友的微信,可能就是这样被监控窃取的)。

说白了,我们身上值钱的东西,并不一定只有我们的钱包而已。家庭地址、社会关系,还有在公司担任的职务身份等等,都有可能是骗子想要获得的东西。

为此,我想给大家举一个更极端的例子,方便大家感受一下AI诈骗的可怕——

假设我们的手机被人偷了,很快便被转到了AI诈骗的团伙手中。而手机的锁屏设置嘛,破解起来不要太简单…华强北的老师傅们,分分钟就能搞定。

然后骗子将我们的手机接到电脑上,通过AI模拟出一个遭遇车祸的场景。他用微信假装是我们的同事,给我们的爸妈打电话,说我们出车祸受伤了。这便是之前所提到的第一步:实施接触。

接着骗子用手机拍摄下我们受伤的样子(当然这是AI模拟出来的),通话的过程中,满身是伤的我们,只能支支吾吾说出几句含糊的话,但听声音无疑是我们的。于是第二步:获取信任,就达成了。

而通过让我们处于受伤的境地,一方面能使父母快速陷入混乱,另一方面也能减少骗子暴露的痕迹。

接着假冒的医生和护士相继出场,说是要想立即手术治疗,就得先交纳一笔的手术费用。这时那个号称是我们同事的人,对我们的父母说,他身上的钱根本不够…ze我们的父母就只能陷入第三步:服从境地。

后面是否掏空我们父母所有的积蓄,那就完全取决于骗子的良心了…

这样一套剧本下来,有视频有声音,足以获取信任了吧?而这,仅仅只是我一个业余的编剧,随手就能编出来的剧本。

一些骗子甚至还能根据你手机里的聊天记录,来进行量身定制的下套,就如郭先生所遭遇的那样。

换句话说,仅仅只是弄丢手机,就有可能让你身边的人遭受巨大损失。这或许就是官媒们,如此声势浩大地呼吁大家警惕AI诈骗的原因。

AI诈骗的波及面实在是太广太大,没人可以独善其身。

但好在一些科技公司,已经在着手处理这件事情了。它们能够通过眨眼频率、瞳孔形状、还有口型与声音之间的吻合度等等,来判断视频中的人物是否为AI生成。

只是,目前这项技术还只是处于测试当中,距离大范围运用,还有着一段距离。

而就AI诈骗这一问题,我还专门询问过chatGPT。它除了开头直接点出这事非常困难外,剩下给出来的建议,几乎全是正确的废话。

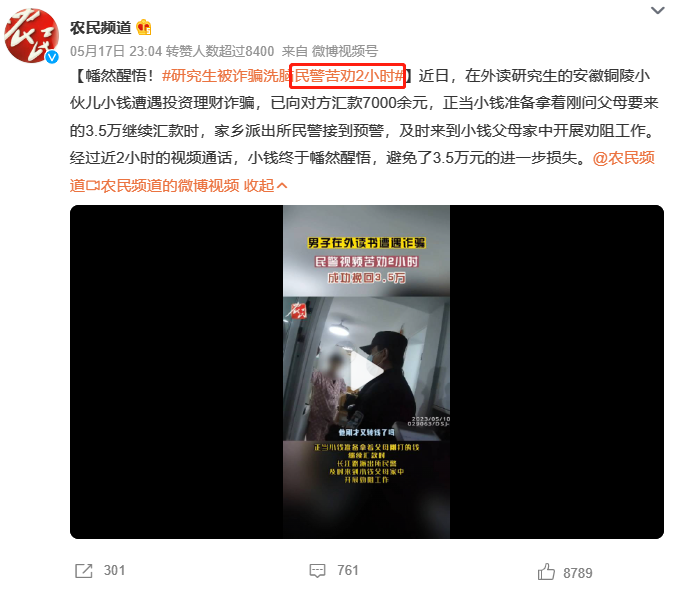

难道目前我们能做的,只有小心翼翼、妥善地管理好自己的手机以及其他电子设备,以防止自己被AI诈骗所波及?

也不全是。

有一项,是AI至今无法突破的——脾气。

早在1990年代,人类学家罗宾·邓巴就提出一个著名的“邓巴数字”。

邓巴提出,人的大脑认知能力决定了人类拥有稳定社交网络的规模上限为148人。其中,深入交往的人数约20人左右。

同理,我们可以画出信任的同心圆。

诈骗,本质上是打破了我们原有的信任链条,重建了一条虚拟的链条。

过去的诈骗,多是利用我们“边际”社交关系,或者假冒警察等公共关系,进行行骗,这种诈骗的“犯罪成本”很低,受害者防范意识也较差。而随着全民反诈,过去的诈骗手段,越来越难奏效。

AI诈骗,更像是为受害者“定制”诈骗方案,伪装成熟人以突破层层同心圆,突破的层数越多,诈骗造成的损失也就越大。

防范这类诈骗,最大的难点,就是具备强烈的反诈意识:意识到声音、图片、视频,都能造假。

真正自己熟悉的人,“脾气”是不会造假的。只要多说几句话,最好是聊一些此前从没聊过的话题,在大数据之外,人的一言一行都是感性的。

AI这个魔盒已经打开,它的好,它的坏,我们都要一步步接受。

眼下AI给我们的“教训”,让我们重新思考平生交往的所有人,哪些才是深交之人,哪些才是AI无法伪装的人。这些人,如果真的急需一笔钱,一定不会怪罪你对他百般验证。

1、本文只代表作者个人观点,不代表星火智库立场,仅供大家学习参考;

2、如若转载,请注明出处:https://www.xinghuozhiku.com/329905.html